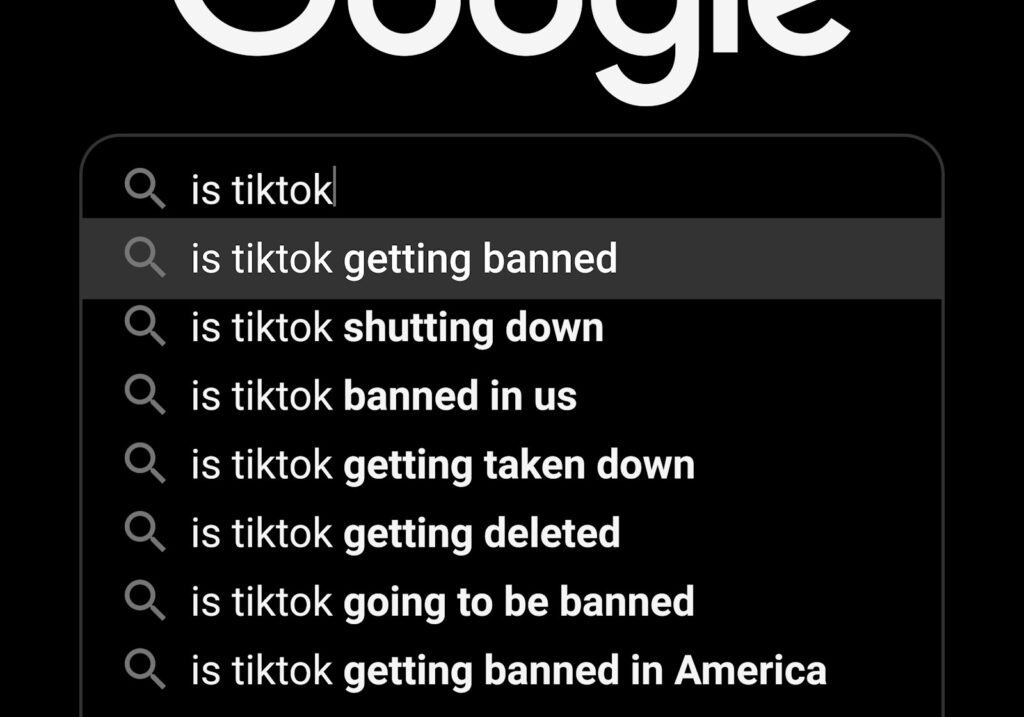

Dacă în ianuarie 2025 părea aproape sigur că TikTok va dispărea de pe telefoanele din SUA, toamna aceluiași an ne-a prins cu aplicația încă vie, dar cu un viitor „în custodie”. Povestea pe scurt: o lege americană a impus vânzarea (altfel, interdicție totală), Curtea Supremă a confirmat ferm cadrul legal, iar Casa Albă a tot împins data-limită în timp ce negocierile pentru un „TikTok sub supraveghere” au avansat. Între timp, pe fundalul marelui joc geopolitic, apare întrebarea care ne privește pe toți: cine are în fapt mâna pe volanul algoritmului care decide ce vezi? Supreme Court+2SCOTUSblog+2

Începutul anului a adus claritate juridică brutală. La 17 ianuarie 2025, Curtea Supremă a SUA a menținut legea „divest-or-ban”, respingând apelul companiei: fără o dezlipire reală de ByteDance, aplicația urma să fie oprită în State. Decizia a fixat o linie roșie atât pentru TikTok, cât și pentru orice platformă considerată „controlată de un adversar străin”. Foaia de parcurs devenea, brusc, binară: vânzare sau „ecran negru”. Supreme Court+2SCOTUSblog+2

Apoi, politica a făcut ceea ce face de obicei: a cumpărat timp. Din aprilie până în septembrie 2025, au venit pe rând ordine executive care au amânat aplicarea sancțiunilor—mai întâi până în iunie, apoi până în septembrie, iar pe 16 septembrie o nouă prelungire a împins termenul până pe 16 decembrie 2025. Oficial, motivul: să nu lovești utilizatorii și creatorii în plin proces de tranziție, câtă vreme există șanse reale pentru un acord de securitate. Neoficial, toată lumea știa că „puzzle-ul” tehnic și juridic—cine deține ce, ce cod pleacă, ce cod rămâne, cine vede datele, cine poate re-antrena algoritmul—nu se rezolvă peste noapte. The White House+1

Acordul de principiu anunțat la final de septembrie a părut, pentru mulți, un compromis de manual. Reuters și Business Insider au vorbit despre o structură în care ByteDance coboară sub 20% din noua entitate din SUA, Oracle și alți investitori americani preiau controlul guvernanței, iar fluxurile de date și algoritmul intră într-un regim de „pază” separată. Pe românește: TikTok rămâne accesibil, dar cu un paznic american care stă la ușa camerei serverelor și a laboratorului în care se „educă” recomandările. E o salvare cu multe asteriscuri: cât de „american” devine un algoritm crescut ani în șir pe date globale și ce înseamnă, practic, „acces controlat”? Reuters+2Business Insider+2

De altfel, ideea de „custodie a algoritmului” nu apare din neant. Încă dinainte de sentința Curții, TikTok promova Project Texas—o arhitectură prin care datele utilizatorilor americani sunt găzduite pe infrastructura Oracle, cu proceduri stricte de acces. Criticii au văzut în versiunea 1.0 a proiectului mai degrabă o „pază la ușa depozitului de date”, dar prea puțin control asupra modului în care se antrenează și se actualizează algoritmul. Acordul din septembrie încearcă să acopere fix această zonă: nu doar unde stau datele, ci cine are drept de intervenție în „creierul” care produce feedul. usds.tiktok.com+2Los Angeles Times+2

Ceea ce rămâne încă tulbure—și, aici, misterul e real, nu o metaforă editorială—e arhitectura fină a separării: unde tragi granița între cod (proprietate intelectuală), modele (parametri) și date (personale și non-personale)? O „custodie” eficientă ar presupune măcar trei niveluri: audit continuu al accesului la date, drept de veto pe versiunile noi de model care intră în producție și jurnalizare a schimbărilor de ranking (cine, când, ce a modificat în factorii de prioritizare). Orice gaură în aceste trei straturi reface, prin lateral, exact legătura pe care legea a dorit s-o taie. Iar decizia Curții a amintit explicit contextul: ByteDance este supusă legislației chineze privind cooperarea cu serviciile de informații—adică nu e o suspiciune generică, ci o obligație legală în jurisdicția de origine. Supreme Court

Tensiunea adevărată nu e între „SUA vs. China”, ci între două moduri de a defini suveranitatea digitală. Unul spune: „controlăm granițele datelor (data localization) și ne asigurăm că operatorul local răspunde în fața legii noastre”. Celălalt adaugă: „controlăm și granițele algoritmice (model localization) pentru că influența nu stă doar în ce colectezi, ci și în ce distribui”. Dacă această filozofie se impune, 2026 ar putea fi anul în care marile platforme vor arăta diferit în funcție de jurisdicție—nu doar prin moderare, ci chiar prin „gustul” feedului. Un fel de geofencing algoritmic.

Creatorii? Ei simt primii orice schimbare de gust. Un filtru nou la brand safety și un re-rank pe conținut „politic” poate tăia la jumătate (sau dubla) audiența într-o săptămână. De aici și teama recurentă de „shadowban”—uneori real, alteori doar efectul colateral al unui update. O „custodie” serioasă ar trebui să includă un fel de „fișe tehnice ale platformei”: ce semnale contează, cu ce ponderi aproximative, ce perioade de test A/B rulează, când apar schimbări majore și cum e notificată comunitatea. În fond, Curtea a recunoscut dreptul statului de a cere separare pentru securitate națională; la fel de legitim este dreptul publicului de a ști, la un nivel rezonabil, după ce reguli curge atenția sa. SCOTUSblog

Și totuși, chiar dacă acordul pare să închidă rana politică, rămân semne de întrebare grele. Cine are voie să re-antreneze modelele pe date noi din SUA și cu ce seturi de validare? Ce se întâmplă cu evoluțiile transfrontaliere—de pildă, o funcție testată global care schimbă „gusturile” recomandărilor—intră automat și în versiunea americană sau trebuie „tradusă” local, cu audit? Ce garanții există că un model supravegheat în SUA nu e „rulat” în paralel, experimental, în altă jurisdicție, iar rezultatele ajung indirect în produs? Toate aceste neliniști nu sunt teorie: presa americană a subliniat deja că rolul Oracle de „gardian” fusese încercat în trecut—cu „goluri” de implementare pe care noul acord promite să le închidă. Diavolul e în detalii, iar detaliile sunt, deocamdată, redactate în limbaj de termeni și condiții. Los Angeles Times+1

Mai e și dimensiunea simbolică. Pentru prima oară, două capitale aflate în rivalitate deschisă au desenat un compromis tehnologic ce admite explicit că algoritmii nu mai sunt doar „know-how” privat, ci infrastructură cu relevanță de securitate națională. Reuters și Business Insider au vorbit despre o tranzacție evaluată în jur de 14 miliarde de dolari și o guvernanță în care americanii dețin șase din șapte locuri în boardul noii companii. Asta e mai mult decât o decontare corporatistă; e un model exportabil pentru alte crize: „rămâi pe piață dacă pui creierul sub pază locală”. Eficiența? Abia urmează să fie probată. Reuters+1

Între timp, „hardware-ul” politic se aliniază. În Texas se consolidează hub-ul tehnic care ar trebui să țină datele la adăpost, iar în Washington se scriu liniile de ghidaj pentru cum se face auditul algoritmic fără a-ți dezvălui armele secrete. Paradoxul custodiei este că trebuie să fie destul de intruzivă ca să ofere încredere, dar destul de discretă ca să nu calce proprietatea intelectuală. Dacă în decembrie 2025 termenele se respectă și entitatea americană e pe deplin operațională, 2026 va fi primul test real: comunitatea va simți pe bune dacă „TikTok-ul american” e la fel, mai steril sau, ironic, mai politicizat tocmai prin încercarea de a-l depolitiza. TechCrunch

Există, firește, și varianta întunecată: ca întreaga „custodie” să rămână un decor elegant peste practici greu de verificat. De aceea, dincolo de decizii și ordine executive, contează mecanismele independente: rapoarte trimestriale de transparență cu granularitate pe ranking, acces pentru cercetători la panouri de date anonimizate, drept de replică procedural pentru creatorii afectați grav de schimbări, „red team” externe care să atace sistematic toate breșele posibile. Fără acest ecosistem de control, custodia riscă să fie doar un cuvânt frumos pentru „crede-ne pe cuvânt”.

Iar dacă te întrebi unde e „conspirația”, e chiar în întrebare: cu toții vrem un feed „neutru”, dar adevărul e că niciun feed nu e neutru. E suma unor alegeri tehnice și politice, a unor costuri și a unor riscuri pe care cineva—companie sau stat—decide să le accepte. Custodia nu elimină politica din algoritm; doar mută cheia de la o ușă la alta. Cine păzește paznicul? Răspunsul—ca întotdeauna—stă în câtă lumină reușim să aruncăm pe mecanism.